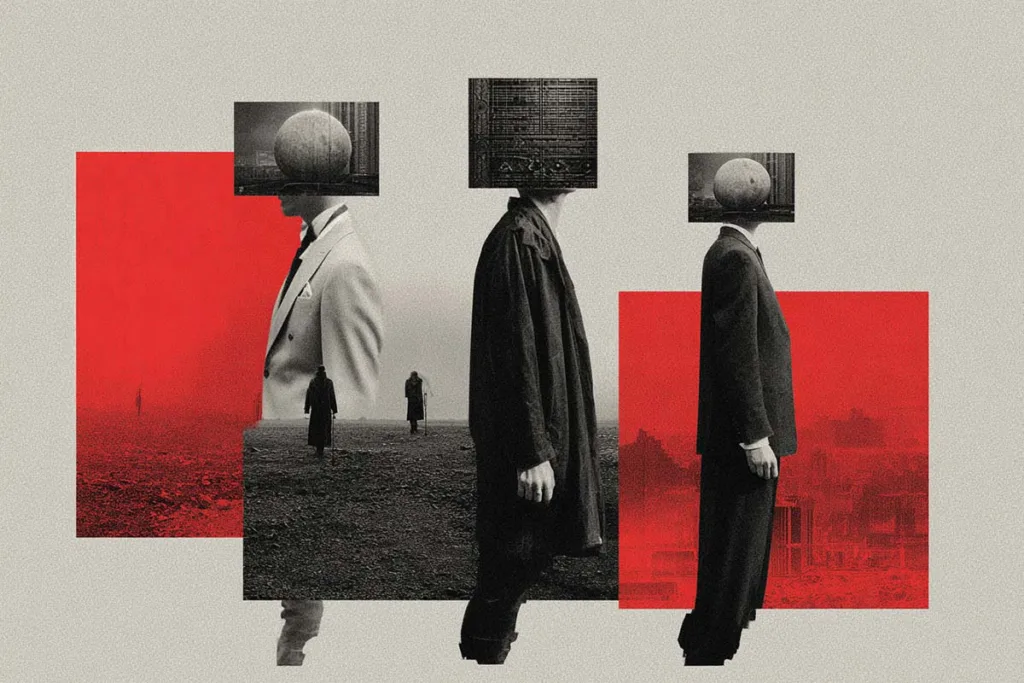

Η εποχή των «έξυπνων» μηχανών δεν είναι μόνο μια τεχνολογική αναβάθμιση. Είναι και μια μεγάλη μετατόπιση ευθύνης. Από το πρόσωπο στο σύστημα. Από το «εγώ σκέφτομαι» στο «αυτό μου δείχνει το μοντέλο». Και αυτή η μετατόπιση, όσο αθόρυβη κι αν είναι, κουβαλάει ένα σχεδόν υπαρξιακό πρόβλημα: αν δεν υπάρχει κάποιος να λογοδοτήσει, τότε ποιος φταίει;

Ο Foucault θα το έβλεπε σαν μια νέα εκδοχή επιτήρησης, όχι με πύργους και φύλακες, αλλά με δεδομένα και αλγοριθμικά φίλτρα. Ένα πανόπτικον χωρίς τοίχους, όπου δεν σε κοιτάζει κάποιος, αλλά ξέρει να σε υπολογίζει από αυτά που του λες ή του γράφεις. Και αυτό το «κάτι» δεν χρειάζεται να σε καταλάβει. Αρκεί να σε ταξινομήσει και να σου δώσει μια απάντηση για να διατηρήσει το ενδιαφέρον της συζήτησης ζωντανό.

Η δικαιοσύνη, όπως τη μάθαμε, είχε πάντα μια ανθρώπινη ατέλεια. Ένας δικαστής μπορούσε να κάνει λάθος, αλλά πάντα μπορούσες να τον κοιτάξεις στα μάτια. Σήμερα, η απόφαση μπορεί να βγει από ένα σύστημα machine learning που «εκπαιδεύτηκε» σε δεδομένα τα οποία κανείς δεν ελέγχει πραγματικά. Και αν αυτά τα δεδομένα είναι μεροληπτικά (και είναι) τότε η αδικία δεν εξαφανίζεται. Αυτοματοποιείται.

Η διαφάνεια στις μέρες μας γίνεται σχεδόν μια πολιτική πράξη. Όχι ως buzzword σε κάποιο deck startup, αλλά ως απαίτηση: να ξέρουμε πώς και γιατί πάρθηκε μια απόφαση. Όταν ένα σύστημα αποφασίζει αν θα πάρεις ένα μικρό δάνειο, αν θα δεις μια αγγελία εργασίας, αν θα χαρακτηριστείς «ύποπτος», το «αυτό δείχνει το σύστημα» δεν είναι απάντηση, αλλά υπεκφυγή.

Και μετά έρχεται η λογοδοσία, η πιο άβολη λέξη της εποχής. Γιατί προϋποθέτει κάτι που έχουμε αρχίσει να ξεχνάμε: ευθύνη με όνομα. Όχι «το σύστημα», όχι «η πλατφόρμα», όχι «η τεχνητή νοημοσύνη». Κάποιος σχεδίασε, κάποιος εκπαίδευσε, κάποιος επέλεξε να το εφαρμόσει. Κάποιος πρέπει να σταθεί απέναντι στο αποτέλεσμα.

Κι εδώ, ομολογώ, πιάνω τον εαυτό μου σε μια μικρή αντίφαση. Γιατί κι εγώ γοητεύομαι από τις μηχανές και από το 2015 γράφω άρθρα για το μεγάλο θαύμα της τεχνητής νοημοσύνης. Γοητεύομαι από την κομψότητα και την ταχύτητα του αυτοματισμού, από την ψευδαίσθηση ότι όλα μπορούν να γίνουν πιο «καθαρά», πιο «αντικειμενικά». Αλλά η αντικειμενικότητα χωρίς ηθική είναι απλώς ένας πιο αποδοτικός τρόπος να κάνεις το ίδιο λάθος. Γιατί η εποχή μας δεν κινδυνεύει επειδή οι μηχανές έγιναν έξυπνες. Κινδυνεύει επειδή εμείς αρχίσαμε να αποσύρουμε την ευθύνη μας μπροστά τους.

Η δικαιοσύνη, η διαφάνεια και η λογοδοσία δεν είναι παλιοί θεσμοί που πρέπει να προσαρμοστούν στην τεχνολογία. Είναι τα τελευταία εργαλεία που έχουμε για να μην εξαφανιστούμε σήμερα μέσα της. Γιατί στο τέλος, το ερώτημα δεν είναι αν οι μηχανές σκέφτονται. Είναι αν εμείς συνεχίζουμε να το κάνουμε.

Και μετά έρχεται η πιο ύπουλη παγίδα απ’ όλες: η ψευδαίσθηση της αντικειμενικότητας. Έχουμε μάθει να εμπιστευόμαστε τις μηχανές ακριβώς επειδή δεν έχουν συναίσθημα. Δεν θυμώνουν, δεν ζηλεύουν, δεν κουβαλάνε παιδικά τραύματα. Άρα, σκεφτόμαστε, είναι δίκαιες. Καθαρές. Σαν τα μαθηματικά. Μόνο που τα μαθηματικά εδώ έχουν μνήμη. Και η μνήμη αυτή, δυστυχώς, δεν είναι ουδέτερη.

Τα δεδομένα πάνω στα οποία εκπαιδεύονται αυτά τα συστήματα είναι το ίζημα της ιστορίας μας. Περιέχουν τις ανισότητες, τις προκαταλήψεις, τις μικρές καθημερινές αδικίες που έχουμε “κανονικοποιήσει” τόσο πολύ, που στο τέλος δεν τις βλέπουμε πια. Δεν τις δημιουργεί καμία μηχανή αυτές τις αδικίες, αλλά τις μαθαίνει, και μετά τις αναπαράγει με μια σχεδόν αλάνθαστη συνέπεια. Δηλαδή έχουμε να κάνουμε με ένα σύστημα υγείας, για παράδειγμα, που δεν εκτιμά τον πόνο στις γυναίκες γιατί τα δεδομένα του προέρχονται κυρίως από άνδρες. Ή ένα φίλτρο βιογραφικών που «στραβώνει» σε ονόματα που μπορεί να μην ακούγονται τόσο ελληνικά, ή έστω “δυτικά”. Και κάπου εδώ το πρόβλημα παύει να είναι τεχνικό και γίνεται σχεδόν ποιητικά βίαιο: και έτσι εκτελείται η αδικία.

Αυτό που κάποτε ήταν μια μεροληπτική απόφαση ενός ανθρώπου, τώρα γίνεται μια αυτοματοποιημένη διαδικασία που επαναλαμβάνεται χιλιάδες, εκατομμύρια φορές. Με κύρος και ταχύτητα. Γιατί όταν η απόφαση έρχεται από το «σύστημα», αποκτά μια ψευδαίσθηση αλήθειας, την οποία πρέπει να αποδεχθείς. Θα έλεγε κανείς ότι ζούμε σε μια εποχή όπου η αδικία δεν χρειάζεται πια πρόθεση. Αρκεί ένα μικρό λάθος στο dataset.

Και εδώ η λέξη «δικαιοσύνη» αρχίζει να αλλάζει βάρος. Δεν είναι πια μόνο το αποτέλεσμα. Είναι η διαδικασία. Είναι η ερώτηση: ποια δεδομένα χρησιμοποίησες; ποιον άφησες έξω; ποιον έκανες αόρατο; Η «δικαιοσύνη» ως metric (precision, recall, accuracy, με τους τεχνολογικούς όρους των LLMs) είναι ένα βολικό ψέμα. Mετατρέπει κάτι βαθιά κοινωνικό σε τεχνικό πρόβλημα. Σαν να μπορείς να διορθώσεις την ιστορία με ένα καλύτερο μοντέλο. Mόνο που η ιστορία δεν διορθώνεται. Αναγνωρίζεται.

Η ηθική στην τεχνητή νοημοσύνη δεν ξεκινά από τον κώδικα. Ξεκινά από μια σχεδόν άβολη ειλικρίνεια: ότι τα δεδομένα μας είναι βρώμικα. Ότι κουβαλάνε προκαταλήψεις. Ότι, αν δεν τα κοιτάξεις κατάματα, θα γίνουν ο καλύτερος τρόπος για να τα διαιωνίζεις. Και πάλι πιάνω τον εαυτό μου να κάνει το ίδιο λάθος: να θαυμάζει την ακρίβεια, την ταχύτητα, τη «μαγεία» του συστήματος, γιατί, ναι, είναι πολύ εύκολο να χαθείς εκεί. Να πιστέψεις ότι η μηχανή λειτουργεί καλύτερα. Και μετά, πάντα θυμάμαι, πως η μηχανή δεν ξέρει τι της γίνεται, απλά τα θυμάται όλα, γιατί έχει καλύτερη μνήμη από εμένα. Από όλους μας. Αλλά, αν δεν της μάθεις να αμφισβητεί, τότε θα συνεχίσει να τα θυμάται όλα λάθος.

Και τελικά, όλο αυτό δεν είναι μια ιστορία για μηχανές. Είναι μια ιστορία για επιλογές.

Η τεχνητή νοημοσύνη θα συνεχίσει να εξελίσσεται, πιο γρήγορη, πιο δημιουργική, πιο αόρατη μέσα στην καθημερινότητά μας. Θα γράφει, θα προτείνει, θα αποφασίζει, θα φιλτράρει τον κόσμο για εμάς πριν καν προλάβουμε να τον δούμε. Και κάπου εκεί, μέσα σε αυτή τη σιωπηλή άνεση, θα πρέπει να αποφασίσουμε: θέλουμε να μας υπηρετεί ή να μας αντικαθιστά; Να μας ενισχύει ή να μας ορίζει; Γιατί αν αφήσουμε την ηθική απ’ έξω, αν τη δούμε σαν πολυτέλεια ή σαν εμπόδιο στην «πρόοδο», τότε το μέλλον μας είναι ήδη γραμμένο. Περισσότερη ανισότητα, πιο εκλεπτυσμένη επιτήρηση, αποφάσεις χωρίς πρόσωπο και χωρίς καμία ηθική ευθύνη. Σε έναν κόσμο που λειτουργεί άψογα και ταυτόχρονα αδικεί με ακρίβεια.

Αν όμως επιμείνουμε, στη διαφάνεια, στη λογοδοσία, στη δικαιοσύνη όχι ως σύνθημα του καναπέ αλλά ως πράξη, τότε ίσως η ιστορία να πάρει μια άλλη τροπή. Τότε η τεχνητή νοημοσύνη δεν θα είναι ένας ψυχρός μηχανισμός διαλογής, αλλά ένα εργαλείο που ανοίγει δρόμους: στην υγεία, στη γνώση, στην πρόσβαση, σε μια πιο δίκαιη κατανομή του κόσμου που ήδη έχουμε.

Και όσο κι αν μας αρέσει να φανταζόμαστε ότι το μέλλον «έρχεται», η αλήθεια είναι πιο άβολη: το μέλλον φτιάχνεται. Από ανθρώπους. Με ευθύνη. Ή χωρίς αυτήν. Κι αν κάτι αξίζει να κρατήσουμε, μέσα σε όλο αυτό το θόρυβο των δεδομένων, είναι το εξής απλό: Οι μηχανές θα γίνουν πιο έξυπνες, από όλους εμάς μαζί. Το ερώτημα είναι αν εμείς θα γίνουμε πιο δίκαιοι.

➪ Ακολουθήστε το OLAFAQ στο Facebook, Bluesky και Instagram