Ως λάτρης ταινιών επιστημονικής φαντασίας, πάντα γοητευόμουν από το ουτοπικό όραμα της τεχνητής νοημοσύνης ως βοηθού που φροντίζει για κάθε μου ανάγκη ή απωθημένο, είτε πρόκειται για την πανταχού παρούσα φωνή της Scarlet Johannson στην ταινία Her, είτε για ένα στοργικό ρομπότ στο Big Hero 6, είτε για τον J.A.R.V.I.S. στο Iron Man. Σε ποιον δεν θα άρεσε να μην ανησυχεί για χιλιάδες αδιάβαστα μηνύματα ηλεκτρονικού ταχυδρομείου, να έχει έναν προσωπικό οδηγό υγείας που παίρνει αποφάσεις για εσάς ώστε να μπορείτε να παραμείνετε σε φόρμα, ή να αναθέτει τη διαχείριση μιας επιχείρησης πολλών δισεκατομμυρίων ευρώ ώστε να μπορείτε να παίξετε έναν σούπερ ήρωα; Τα ευφυή συστήματα με δυνατότητα AI θα επιλέγουν το καλύτερο User Interface πρότυπο για κάθε δεδομένο σενάριο χρήστη με μεγαλύτερη ακρίβεια από ό,τι θα μπορούσε να αποφασίσει οποιοσδήποτε άνθρωπος. Τι πρέπει να κάνουν οι σχεδιαστές για να προετοιμαστούν για αυτό το ενδεχόμενο;

Η τεχνητή νοημοσύνη είναι μια μετασχηματιστική τεχνολογία με την οποία μόλις αρχίσαμε να πειραματιζόμαστε. Ωστόσο, η ιστορία δεν τελειώνει με τα πολυμορφικά “User Interface” που εμφανίζονται προληπτικά. Για να βασίζονται οι άνθρωποι στα ευφυή συστήματα, τα συστήματα πρέπει να επιδεικνύουν ανθρώπινες αξίες, ηθική λήψη αποφάσεων, διαφάνεια στη λήψη αποφάσεων, σεβασμό της ιδιωτικής ζωής, ασφάλεια δεδομένων, ιχνηλασιμότητα, δικαιοσύνη και ένταξη, συμφραζόμενα και ένα σωρό άλλες εκτιμήσεις.

«Όταν μια τεχνητή νοημοσύνη εκπαιδεύεται στην ανθρώπινη εμπειρία ολόκληρου του διαδικτύου, οι εταιρείες που τα κατέχουν θα πρέπει να είναι υποχρεωμένες να επιστρέψουν με τρόπους που δημιουργούν πραγματική αξία για όλους».

Η προκατάληψη των εταιρειών σχετικά με το UI.

Η υλοποίηση ενός AI-enabled πολυμορφικού «θυρωρού» (όπως αναφέρεται στον παραπάνω σύνδεσμο), που θα προστατεύει τους ανθρώπους και την κοινωνία, προϋποθέτει τον επαναπροσδιορισμό του τρόπου με τον οποίο μια επιχείρηση κατασκευάζει, διαχειρίζεται και συντηρεί τέτοια συστήματα. Να γιατί – η κουλτούρα και οι λειτουργίες μιας επιχείρησης επηρεάζουν σε μεγάλο βαθμό τις αποφάσεις που έχουν αντίκτυπο στον τρόπο με τον οποίο θα λειτουργήσει τελικά μια υπηρεσία με δυνατότητα AI.

Ένα προϊόν ή μια υπηρεσία με τεχνητής νοημοσύνης αντανακλά τις αξίες, τους ανθρώπους, τις διαδικασίες και τις μετρήσεις που προωθεί και υποστηρίζει ο οργανισμός. Για τη συνοχή του σκοπού, οι εταιρείες πρέπει να υιοθετήσουν επιχειρηματικά μοντέλα και συστήματα που συνδέουν την ευημερία των ανθρώπων και της κοινωνίας με τον πυρήνα της επιχειρηματικής επιτυχίας και αντανακλώνται απτά στα προγράμματα παροχής κινήτρων στους εργαζομένους. Το να έχετε μια καλοσχεδιασμένη δήλωση αποστολής ή αφίσες με τις αρχές και τις αξίες σας σε κάθε τοίχο του γραφείου δεν αρκεί για να διασφαλίσετε την ευθυγράμμιση ούτε τον αντίκτυπο – οι ερευνητές και οι προγραμματιστές χρειάζονται ρητή κατεύθυνση από τα πάνω προς τα κάτω που να αντανακλάται εξωτερικά ώστε να διατηρηθεί η λογοδοσία. Οι κυβερνήσεις διαμορφώνουν σαφέστερες απόψεις για το πώς πρέπει να λειτουργεί η τεχνητή νοημοσύνη και καθορίζουν προοδευτικά αυστηρότερες πολιτικές για την προστασία των ανθρώπων και της κοινωνίας. Οι εργαζόμενοι, τα ενδιαφερόμενα μέρη και οι μέτοχοι θα πρέπει να έχουν μια κοινή γλώσσα σχετικά με την εξισορρόπηση της κερδοφορίας, με τη διαφύλαξη και την ιεράρχηση της ασφάλειας των ανθρώπων και της διαχείρισης των δεδομένων τους.

Οι Διευθύνοντες Σύμβουλοι πρέπει να προσαρμόζουν και να αναδιαμορφώνουν τους οργανισμούς με μοναδικές δεξιότητες, διαδικασίες και μεθόδους για να εξασφαλίσουν επαρκή προστασία που θα προσφέρει ηθικά αποδεκτά αποτελέσματα και αξία. Ενώ η τεχνητή νοημοσύνη θα φέρει αποδοτικότητα στην επιχείρηση απελευθερώνοντας πόρους, οι πόροι αυτοί πρέπει να επικεντρωθούν σε ένα νέο σύνολο ευθυνών για τη διασφάλιση της κοινωνίας – το διάγραμμα Venn των πόρων μετακινείται από τη διαχείριση προϊόντων στη διακυβέρνηση και την εποπτεία. Οι επιχειρήσεις θα πρέπει να πειραματιστούν με στρατηγικές αποπληρωμής και αποζημίωσης για να δώσουν κίνητρα στους εργαζόμενους να κάνουν το σωστό, ακόμη και αν αυτό σημαίνει απώλεια εσόδων. Οι ιδρυτές των εταιριών θα πρέπει να διαχειριστούν τις προσδοκίες των επενδυτών όταν οι αποφάσεις σε κοινωνικό επίπεδο κρέμονται από μια κλωστή σχετικά με την έναρξη συστημάτων που δεν έχουν δοκιμαστεί ή επαληθευτεί σε μεγαλύτερη κλίμακα.

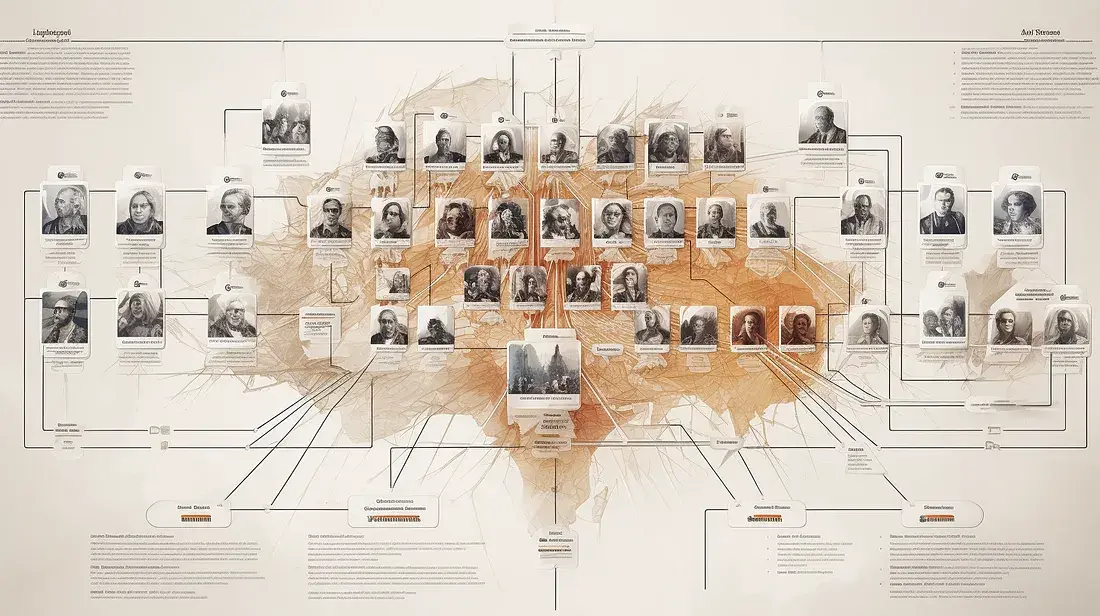

Ένα εταιρικό οργανόγραμμα που μοιάζει με τη δομή του ανθρώπινου εγκεφάλου.

Ποιος αποφασίζει τι είναι καλύτερο για τους ανθρώπους;

Καθώς η αξιοπιστία της κατανόησης της τεχνητής νοημοσύνης αυξάνεται, τα μεγάλα ΑΙ συστήματα θα κατανοούν περισσότερες από τις πολύπλοκες πλευρές της ανθρώπινης επικοινωνίας. Η τεχνητή νοημοσύνη θα μπορεί να μαθαίνει περισσότερα από λιγότερα δεδομένα για λόγους αποδοτικότητας και αποτελεσματικότητας, βελτιώνοντας την ακρίβεια της σύνθεσης των ανθρώπινων εισροών για τη δημιουργία ακριβέστερων συστάσεων για τη βελτίωση των αποτελεσμάτων. Με απλά λόγια:

«Ένας εικονικός θυρωρός που παρέχει ό,τι χρειάζεται με βάση την κατανόηση του ποιος είστε, και γίνεται καλύτερος όσο περισσότερο αλληλεπιδράτε μαζί του». – Rachel Kobetz

Σε αυτόν τον κόσμο, η τεχνητή νοημοσύνη θα βελτιωθεί εκθετικά στην κατανόηση των μη λεκτικών και λεκτικών συμβόλων επικοινωνίας, των συνηθειών και της εξάντλησης των δεδομένων σας, ώστε να καταρτίσει ένα προφίλ υψηλής αξιοπιστίας για εσάς καλύτερα από ό,τι θα μπορούσε να καταρτίσει οποιοσδήποτε άνθρωπος. Θα επιτύχει ένα επίπεδο οικειότητας με το άτομο που θα φαίνεται προφητικό, προσφέροντας τις σωστές απαντήσεις, προτάσεις και προληπτικές ενέργειες, πανεύκολα.

Οι κόκκινες ομάδες σας βοηθούν να προετοιμαστείτε για απρόβλεπτα αποτελέσματα.

Οι σχεδιαστές προϊόντων επικεντρώνονται στο σχεδιασμό λύσεων που απευθύνονται στις ανεκπλήρωτες ανάγκες των χρηστών, υιοθετώντας μια νοοτροπία ενσυναίσθησης για να τους βοηθήσουν να επιτύχουν τους στόχους τους. Διεξάγουν έρευνα για την αποκάλυψη γνώσεων, δημιουργούν υποθέσεις και κατασκευάζουν και δοκιμάζουν πρότυπα, κινούμενοι σταδιακά προς λύσεις που μπορούν να παρέχουν χαρακτηριστικά που βελτιώνουν την εμπειρία του χρήστη. Πρόκειται για μια αποτελεσματική, εξορθολογισμένη διαδικασία, αλλά παράλληλα για μια λειψή μεθοδολογία.

Οι κόκκινες ομάδες λειτουργούν με έναν εντελώς διαφορετικό τρόπο. Αρχικά, οι Red Reams ήταν «χάκερς» που προσλαμβάνονταν για να βρουν τρόπους παραβίασης των συστημάτων ασφαλείας για τους τεχνικούς διευθυντές, οι οποίοι διενεργούσαν δοκιμές διείσδυσης, ώστε να εντοπίσουν τα κενά στα μέτρα τους, να μετριάσουν τα λάθη και να ενισχύσουν τις αδυναμίες αφού τις είχαν εντοπίσει οι χάκερς.

Όταν σχεδιάζουν προϊόντα με τεχνητή νοημοσύνη από το μηδέν, οι σχεδιαστές μπορούν να πάρουν ένα παράδειγμα από το εγχειρίδιο της Κόκκινης Ομάδας και να σκεφτούν τρόπους με τους οποίους η τεχνητή νοημοσύνη θα μπορούσε να προσφέρει αρνητικά αποτελέσματα μέσω πραγμάτων όπως η έλλειψη διαφάνειας ή δικαιοσύνης, να εξετάσουν πώς κακόβουλοι φορείς θα μπορούσαν να χειραγωγήσουν την τεχνητή νοημοσύνη για να επηρεάσουν αρνητικά την απόδοση του μοντέλου ή να εφαρμόσουν την τεχνητή νοημοσύνη σε διαφορετικές περιπτώσεις χρήσης για να προκαλέσουν βλάβη. Μπορούν επίσης να κάνουν καταιγισμό ιδεών για το πώς η τεχνητή νοημοσύνη μπορεί να παρασυρθεί με την πάροδο του χρόνου ή να αναπτύξει αναδυόμενες ικανότητες που μπορεί να μην ευθυγραμμίζονται με τον αρχικό επιδιωκόμενο σκοπό. Με τη διεξαγωγή brainstorming ιδεών της Κόκκινης Ομάδας, οι ομάδες προϊόντων μπορούν να αξιολογήσουν κατά πόσον μια τεχνητή νοημοσύνη είναι κατάλληλη για το σκοπό της. Οι ομάδες διεξάγουν τυπικές συνεδρίες brainstorming ιδεών απαντώντας σε υποθετικές ερωτήσεις «τι θα γινόταν αν», όπου ο στόχος είναι να δημιουργηθεί ένας κατάλογος σεναρίων «πώς θα μπορούσε να πάει στραβά». Οι συμμετέχοντες στους τομείς της προστασίας της ιδιωτικής ζωής, της συμμόρφωσης, της ηθικής, της φιλοσοφίας, των πολιτικών και ανθρωπίνων δικαιωμάτων, της μηχανικής και της ασφάλειας στον κυβερνοχώρο καλούνται να φορέσουν ρόλους μαύρου καπέλου για να επεξεργαστούν τις νέες ιδέες προϊόντων. Οι τεχνικοί διευθυντές μπορούν επίσης να εφαρμόσουν αυτή τη διαδικασία σε υπάρχοντα προϊόντα για να τα απομονώσουν από ανεπιθύμητα αποτελέσματα. Τελικά, αυτή η προσέγγιση έχει ως στόχο να βοηθήσει στην αξιολόγηση των κινδύνων, στον εντοπισμό νέων χρήσεων και ευκαιριών και στη βελτίωση και επέκταση της συνολικής εκτίμησης της ομάδας για μια αυστηρή προσέγγιση στο σχεδιασμό και την ανάπτυξη ισχυρών λύσεων τεχνητής νοημοσύνης που προστατεύουν τους ανθρώπους, την κοινωνία και την εταιρεία.

Ακολουθεί ένα παράδειγμα σεναρίου για τα πιθανά μειονεκτήματα της ύπαρξης ενός πανταχού παρόντος, ιδιαίτερα οικείου συγκυβερνήτη τεχνητής νοημοσύνης.

«Φανταστείτε μια πανταχού παρούσα αόρατη τεχνητή νοημοσύνη που μπορεί να βλέπει και να θυμάται ό,τι κάνετε, έχοντας γνώση της κάθε σας λέξης και πράξης, ώστε να μπορεί να παρέχει εύκολα πληροφορίες και υπηρεσίες σε συνάρτηση με το πλαίσιο, βολικές, εξατομικευμένες και μη παρεμβατικές. Επιφανειακά, αυτό το σύστημα θα ήταν ο απόλυτος βοηθός, που θα μεταμόρφωνε τη ζωή σας και θα απελευθέρωνε τον χρόνο σας, ώστε να μπορείτε να επικεντρωθείτε στα ουσιώδη πράγματα της ζωής.

Με αυτό το επίπεδο δεδομένων, τα μοντέλα θα μπορούσαν να προβλέψουν ολόκληρη την ημέρα σας, επηρεάζοντας κάθε σας απόφαση χωρίς να το συνειδητοποιείτε. Όσοι έχουν τα χρήματα για να αποκτήσουν έναν βοηθό με τεχνητή νοημοσύνη θα τους δοθεί ένα χρυσό εισιτήριο στη ζωή, αυξάνοντας αμείλικτα το χάσμα μεταξύ πλουσίων και φτωχών. Οι άνθρωποι θα ζούσαν σε έναν κόσμο υπερ-εξατομικευμένων εμπειριών που, επιφανειακά, θα φαίνονταν μαγικές. Οι άνθρωποι που μοιράζονται περισσότερα δεδομένα θα αποκτούν περισσότερες “υπερδυνάμεις” τεχνητής νοημοσύνης, συνεχίζοντας τον κύκλο. Οι άνθρωποι που δεν έχουν πρόσβαση στην ΤΝ θα εξακολουθούν να καταγράφονται χωρίς να έχουν κανένα τρόπο να εξαιρεθούν από τη συλλογή δεδομένων της. Για όσους ωστόσο υιοθετούν την τεχνητή νοημοσύνη, η κοσμοθεωρία τους και οι προσδοκίες τους για τους ανθρώπους, γενικότερα, θα μεταβληθούν από τις χιλιάδες εμφανείς και έμμεσες συστάσεις που λαμβάνουν καθημερινά, διαχωρίζοντάς τους από τους μη, υποβαθμίζοντας τις κοινές πεποιθήσεις και τα κοινά σημεία της κοινωνίας».

Οι μπλε ομάδες (ομάδες που επικεντρώνονται σε θετικές λύσεις) θα μπορούσαν να αναλύσουν το σενάριο, να κατηγοριοποιήσουν τους περιγραφόμενους κινδύνους και να αναζητήσουν τρόπους μετριασμού των δυσμενών αποτελεσμάτων, θέτοντας ερωτήματα τύπου «Πώς θα μπορούσαμε» για να διασφαλίσουν ότι οι πανταχού παρούσες ΕΕ (ΤΝ) δεν θα μπορούν να βλάψουν τους ανθρώπους ή να τους επηρεάσουν με τρόπους που δεν είναι επωφελείς για την ευημερία τους ή τη σταθερότητα της κοινωνίας.

Ποιο είναι το μέλλον του σχεδιασμού;

Ο σχεδιασμός προϊόντων θα έχει να κάνει λιγότερο με το να ιδρώνουμε τα pixels σε ένα User Interface, να ανησυχούμε για τα συστατικά στη βιβλιοθήκη προτύπων ή για τις αποφάσεις περιεχομένου που πήγαν στο σύστημα πλοήγησης – αν και όλα αυτά τα πράγματα θα είναι ακόμα απαραίτητα για κάποιο χρονικό διάστημα. Οι νεοσύστατες επιχειρήσεις τεχνητής νοημοσύνης αρχίζουν ήδη να επαυξάνουν και μερικές φορές να αντικαθιστούν το ρόλο του σχεδιαστή σε πολλές τυπικές εργασίες σχεδιασμού προϊόντων και θα επιταχυνθούν και θα βελτιωθούν μόνο με το χρόνο.

Οι σχεδιαστές πρέπει να εξελιχθούν, αξιοποιώντας την ενσυναίσθησή τους για τους χρήστες και να την αξιοποιήσουν σε έναν νέο ρόλο, έναν ρόλο που οδηγεί στη λήψη στρατηγικών αποφάσεων σχεδιασμού και επηρεάζει κάθε λειτουργία που εμπλέκεται στην ανάπτυξη, διαχείριση και διακυβέρνηση ευφυών συστημάτων σήμερα. Για να προστατεύσουν την κοινωνία από ένα δυστοπικό μέλλον, οι σχεδιαστές πρέπει να διευκολύνουν τις συνεργασίες μεταξύ των οργανισμών και να οικοδομήσουν συμμαχίες με οικοσυστήματα εμπειρογνωμόνων και ενδιαφερομένων μερών με τα οποία δεν έχουν συνεργαστεί στο παρελθόν (όπως ειδικοί της δεοντολογίας, υποστηρικτές πολιτικών και ανθρωπίνων δικαιωμάτων, κοινωνιολόγοι, φιλόσοφοι, ψυχολόγοι, οικονομολόγοι και ανθρωπολόγοι), ώστε οι οργανισμοί να δημιουργούν τεκμηριωμένες, συνεκτικές στρατηγικές και μοντέλα λειτουργίας που θα ωφελούν ισότιμα όλες τις κοινότητες. Οι σχεδιαστές πρέπει να μάθουν να εστιάζουν στα συστήματα που σχεδιάζουν και όχι στο σχεδιασμό των συστημάτων, επειδή η τεχνητή νοημοσύνη κατασκευάζεται και ελέγχεται σε πολλές ανταγωνιστικές ατζέντες, συστήματα, διαδικασίες και ανθρώπους. Αντίθετα, τα AI θα επιβλέπουν τελικά τα συστήματα σχεδιασμού στο μέλλον.

Φτιάχνοντας πράγματα που σκέφτονται.

Οι σχεδιαστές έχουν συνηθίσει να πλοηγούνται και να προσαρμόζονται στις μεταβαλλόμενες προκλήσεις του σχεδιασμού, επειδή μέχρι τώρα διατηρούν μια ανθρωποκεντρική προσέγγιση σε όλα όσα κάνουν. Αυτή προσήλωση μπορεί να δει τους σχεδιαστές μέσα από την αναστάτωση των ευφυών συστημάτων συγκυβερνήτη. Το μέλλον του σχεδιασμού υψηλής επίδρασης θα είναι ο έντεχνος σχεδιασμός της νοημοσύνης (AI mind) της υπηρεσίας, ο οποίος συμβαίνει πολύ πριν οποιοδήποτε pixel εμφανιστεί στο γυαλί. Δεν υπάρχουν εγχειρίδια κανονισμών, οπότε οι επικεφαλής των σχεδιαστών πρέπει να επικεντρωθούν στη συγκέντρωση των κατάλληλων ενδιαφερομένων μερών για να λάβουν τεκμηριωμένες αποφάσεις σχετικά με το πώς θα πρέπει να συμπεριφέρεται η τεχνητή νοημοσύνη, σε ποιες περιπτώσεις χρήσης θα πρέπει να αναπτυχθεί, πώς θα εκπαιδεύεται, πώς θα αντιμετωπίζεται όταν τα πράγματα πάνε στραβά. Ποια εξουσία θα έχουν οι χρήστες της πάνω στα δεδομένα τους και στις συστάσεις που παρέχει η τεχνητή νοημοσύνη και κατά πόσον η αξία της ξεπερνά τα εγγενή μειονεκτήματά της. Οι σχεδιαστές θα πρέπει να εξετάσουν κατά πόσο η πλήρης αυτοματοποίηση ορισμένων πραγμάτων υπερτερεί του να αφήνουμε τους ανθρώπους να κάνουν πράγματα με τον παλιό τρόπο, διότι μερικές φορές οι άνθρωποι πρέπει να αφήνονται να αγωνίζονται και να αποτυγχάνουν για να καταφέρουν αναπτυχθούν (πάρτε ως παράδειγμα την εκπαίδευση). Τα AI θα επιτρέψουν στις ομάδες προϊόντων να διαχειρίζονται εξατομικευμένες εφαρμογές σε διαφορετικές κοινότητες, διασφαλίζοντας τα πρότυπα κουλτούρας, την ασφάλεια και την ανθρώπινη δράση.

Τι πρέπει να λάβουν υπόψη τους οι ιδιοκτήτες προϊόντων κατά τη διάρκεια της άνθισης της τεχνητής νοημοσύνης;

1. Να αμφισβητήσετε τις θεμελιώδεις υποθέσεις σχετικά με τα προβλήματα που πρέπει να λύσει ο κόσμος και κατά πόσο η τεχνητή νοημοσύνη είναι η κατάλληλη για αυτές τις λύσεις. Εάν πρόκειται για ένα οικουμενικό πρόβλημα και η λύση μπορεί να είναι άμεσα διαθέσιμη και να λειτουργήσει για όλους, τότε ίσως να πετύχετε μια νίκη.

2. Να διερωτηθείτε αν η αποστολή της ομάδας σας ευθυγραμμίζεται με την ευημερία της κοινωνίας και του πλανήτη. Μήπως οι στόχοι των εσόδων σας προκαθορίζουν τον τρόπο με τον οποίο θα μπορούσατε να αξιοποιήσετε τεχνολογίες που μπορούν να επηρεάσουν την κοινωνία;

3. Επεκτείνετε την έννοια του ρόλου του σχεδιαστή πέρα από κάποιον που επικεντρώνεται αποκλειστικά στο UI ενός προϊόντος. Οι εταιρείες πρέπει να εφαρμόσουν μια προσέγγιση των φιλελεύθερων τεχνών στον στρατηγικό σχεδιασμό της τεχνητής νοημοσύνης, διασφαλίζοντας ότι οι μηχανικοί και οι επιστήμονες δεδομένων είναι καλά ενημερωμένοι σχετικά με τις ηθικές, νομικές και κοινωνικοψυχολογικές επιπτώσεις που μπορούν να έχουν οι υπηρεσίες που αναπτύσσουν. Η σχεδιαστική σκέψη μπορεί να ενδυναμώσει τις συζητήσεις, τα εργαστήρια και τις τακτικές υλοποιήσεις που συνθέτουν και ενσωματώνουν τις απαιτήσεις από πολυάριθμες οπτικές γωνίες, ώστε να διασφαλίζονται δίκαια αποτελέσματα.

4. Η προσαρμογή και η εκμάθηση νέων δεξιοτήτων διασφαλίζει ότι η τεχνητή νοημοσύνη είναι σωστά και ηθικά συντονισμένη προς όφελος των χρηστών, των ενδιαφερομένων μερών, της κοινωνίας και του πλανήτη. Ερώτηση – Θα πρέπει λιγότεροι άνθρωποι να ασχολούνται με το «προϊόν», ώστε περισσότεροι άνθρωποι να μπορούν να ασχοληθούν με τα ηθικά πλαίσια λήψης αποφάσεων για τη διαχείριση των ευφυών συστημάτων;

5. Εξετάστε πώς η σκέψη σχεδιασμού θα μπορούσε να διασφαλίσει ότι οι λύσεις θα είναι δίκαιες και διαθέσιμες σε όλους. Αν όλοι χρειάζονται ένα τηλέφωνο 700 δολαρίων και ευρυζωνικό διαδίκτυο, πιθανότατα θα διαιωνίσετε ανισότητες που έχουν περιθωριοποιήσει κοινότητες για αιώνες.

6. Εξετάστε το ενδεχόμενο εφαρμογής μιας στρατηγικής από τα πάνω προς τα κάτω που ευθυγραμμίζει τις ηθικές, πολιτικές και νομικές εκτιμήσεις με τους επιχειρηματικούς στόχους, ώστε οι ομάδες προϊόντων να έχουν σαφή οπτική επαφή με την επιτυχία. Σκεφτείτε την εκθετική καμπύλη μάθησης στην οποία βρίσκεται η σημερινή τεχνητή νοημοσύνη, προβλέψτε ποια νέα οφέλη και βλάβες μπορεί να προκύψουν και λάβετε τα υπόψιν κατά τη λήψη αποφάσεων.

7. Όταν σχεδιάζετε προϊόντα με AI, να έχετε υπόψη σας ότι δεν πρέπει να συγχέετε την ευκολία του χρήστη με το να κάνετε καλό στον κόσμο. Η ζωή έχει να κάνει με το να μαθαίνεις πώς να αντιμετωπίζεις τα εμπόδια.

8. Αναπτύξτε ισχυρές μεθόδους αξιολόγησης κινδύνων και πλαισίων λήψης αποφάσεων για να διασφαλιστεί ότι οι ομάδες θα εξετάσουν τα οφέλη και τις προκλήσεις της διαχείρισης προϊόντων με δυνατότητα της τεχνητής νοημοσύνης. Δημιουργία και βελτιστοποίηση και αλληλουχία των διαδικασιών και μεθόδων αξιολόγησης των κόκκινων ομάδων, ώστε να διασφαλίζεται ότι οι ομάδες προϊόντων διατηρούν τη δυναμική τους, ενώ κάνουν ό,τι είναι δυνατόν για την προστασία των ανθρώπων και της κοινωνίας.

9. Επικεντρωθείτε στην τρέχουσα ευθύνη της τεχνητής νοημοσύνης και στις ανησυχίες για την προστασία της ιδιωτικής ζωής, εξοικειωθείτε με τις κανονιστικές απαιτήσεις (ιδίως από την ΕΕ) και αναβάλλετε τα οράματα για το μέλλον έως ότου η επιχειρησιακή ωριμότητα του οργανισμού είναι έτοιμη να διαχειριστεί τις πολυπλοκότητες των «σκεπτόμενων μηχανών» του μέλλοντος.